Hauptinhalt

Forschung

Motivation

Wie entstehen in unseren Gehirnen/Geistern (minds) intensionale Zustände, und daraus sensorimotorische Programme zum Erreichen der von uns intendierten Ziele? Wie repräsentieren wir das Wissen, dass sowohl Hunde als auch Katzen Tiere sind, mit denen wir interagieren können, oder dass es keinen Sinn ergibt, einen Kaffee einzugießen ohne zuerst eine Tasse hinzustellen ? Allgemeiner ausgedrückt, wie erhalten Entitäten und Handlungen ihre Bedeutung? Wie reduzieren wir den Rechenaufwand, der erforderlich ist, um aus einer abstrakten Intention ein konkretes, hoch dimensionales motorischen Steuerprogramm für unsere ‚überartikulierten‘ Körper zu erstellen? Und umgekehrt, wie schließen wir aus den hoch dimensionalen sensorischen Signalen auf die Intentionen unserer Mitmenschen?

Die Beantwortung dieser fundamentalen kognitiv-neurowissenschaftlichen Fragen haben viele potentiell relevante Anwendungen. Neben Verhaltensanalyse und -Prädiktion in technischen Systemen (Fahrerassistenz, Recommendersysteme etc.), kann sie dazu beitragen, assistive Technologien oder diagnostische Verfahren für Patienten mit neurologischen oder psychologischen Erkrankungen zu entwickeln, wie z.B. Apraxie oder chronische Schmerzen. Aber auch Anwendungen in sportwissenschaftlichen Kontexten, z.B. personalisiertes Training, sind denkbar.

Inhalt ausklappen Inhalt einklappen Vorarbeiten

Ich postuliere, nach Hommel (2001), eine gemeinsame Kodierung von Bewegungserzeugung und -wahrnehmung auf verschiedenen Ebenen der kortikalen Repräsentationshierarchie. Ein Vorteil einer solchen gemeinsamen Kodierung ist die Möglichkeit, Handlungen zu verstehen indem ihre perzeptuellen Konsequenzen vorhergesagt werden. Um den hierfür notwendigen Rechenaufwand zu reduzieren, haben wir Bayes‘sche maschinelle Lernverfahren entwickelt, um unterschiedliche Bewegungsrepräsentationen zu vergleichen und perzeptuell zu validieren (Velychko et al 2018, Chiovetto et al. 2018, Endres et al 2013). Diese Repräsentationen basieren auf Primitiven, d.h. kurzen, modular rekombinierbaren Bewegungsprogrammen. Unsere Daten legen nahe, dass menschliche Bewegungswahrnehmung nahezu Bayes-optimal ist. Weiterhin konnten wir zeigen, dass diese Bewegungsrepräsentationen nicht nur perzeptuell prädiktiv sind, sondern auch dynamisch stabile Bewegung eines humanoiden Roboters steuern können (Clever et al. 2016, 2017).

Zur Strukturanalyse perzeptueller Hierarchien nutzen wir Formale Begriffsanalyse (FCA), eine Methodik aus der mathematischen Theorie der geordneten Mengen, für semantische neuronale Dekodierung: anstelle einfach nur zu untersuchen, welcher Stimulus präsentiert wurde, konnte ich (und Kollaborateure) zeigen wie sich mit Hilfe von FCA semantische Zusammenhänge (z.B. Hierarchien, “product-of-experts” Kodierung) zwischen den Stimuli explizit darstellen und erkunden lassen, sowohl in neurophysiologischen Daten (Endres et al. 2009, Endres et al. 2010) als auch in fMRI Daten (Endres et al. 2012).

Aktuelle Forschungsrichtungen

Inhalt ausklappen Inhalt einklappen 1. Sensorimotorische Primitive und Hierarchien

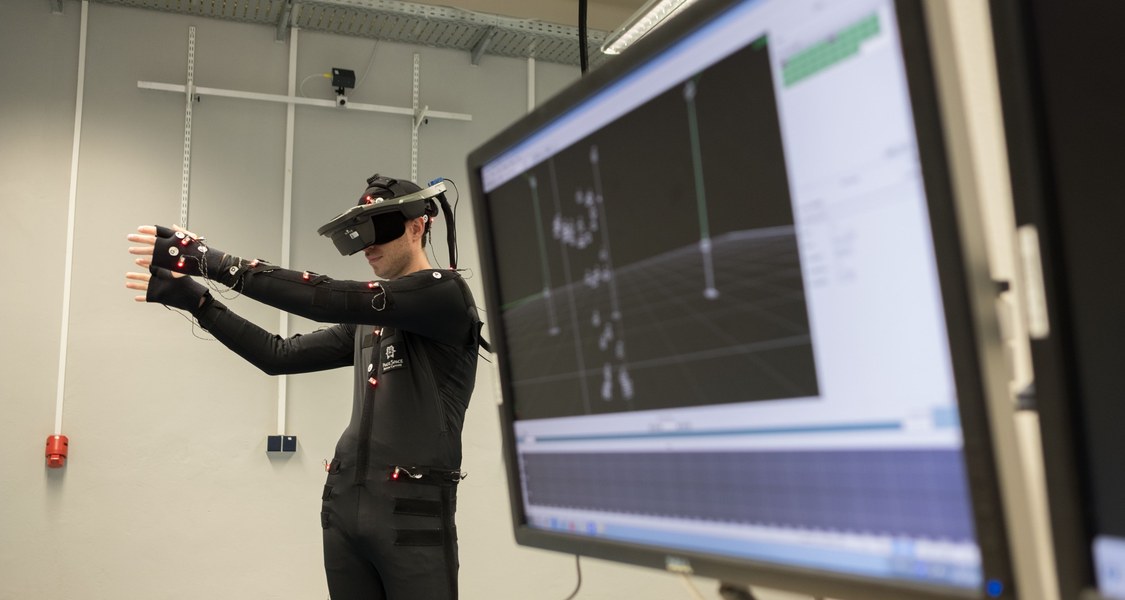

Wir eweitern unsere Bayes‘schen Ansätze zur Selektion optimaler Bewegungsprimitive auf modulare sensorimotrische Primitive, um die postulierte direkte Kopplung zwischen Wahrnehmung und Handlung zu untersuchen. Um eine hohe externe Validität zu erreichen, werden wir große Datenbanken von menschlichen Aktivitäten in möglichst natürlicher Umgebung, inklusive virtueller Realität, aufzeichnen. Die Daten werden sowohl Bewegungaufzeichnungen (Körper und Augen), als auch synchrone sensorische Signale (visuell, haptisch, auditorisch) beinhalten. Wir erwarten, dass eine ähnlich spärliche Repräsentation wie die, die wir bisher für Bewegungsprimitive ermitteln konnten, ausreichen wird, um sensorimotorische Primitive Bayes-optimal zu beschreiben. Daran anschließend werden wir die abstrakteren Ebenen der sensorimotorischen Hierarchie abzubilden versuchen, um schließlich Intentionsrepräsentation zu erreichen.

Inhalt ausklappen Inhalt einklappen 2. Relationale Kodierung in der Wahrnehmung und im maschinellen Lernen

Wir entwickeln Hypothesen/Modelle über die neuronale Repräsentation semantischer Beziehungen im menschlichen Gehirn (weiter). Diese Hypothesen werden wir anhand von Verhaltensexperimenten und FMRI-Aufnahmen überprüfen. Insbesondere beabsichtigen wir mit Hilfe synthetischer Stimuli mit kontrollierbarer Struktur zu untersuchen, wie solche Beziehungen aus den Daten gelernt werden. Diese Stimuli werde ich mit Methoden der Computergraphik erzeugen (Velychko et al 2018, Knopp et al 2019).

Zur Validierung und zur technischen Verwertbarkeit der so gewonnenen Einsichten werde wir ein vereinheitlichtes maschinelles Lernsystem entwickeln, in dem Formale Begriffsanalyse mit probabilistischem Lernen fusioniert wird, im Kontext stochastischer Prozesse. Wir werden so einen wichtigen Beitrag zum deep model structure learning zu liefern, welches ein hochaktuelles Forschungsthema im maschinellen Lernen ist.